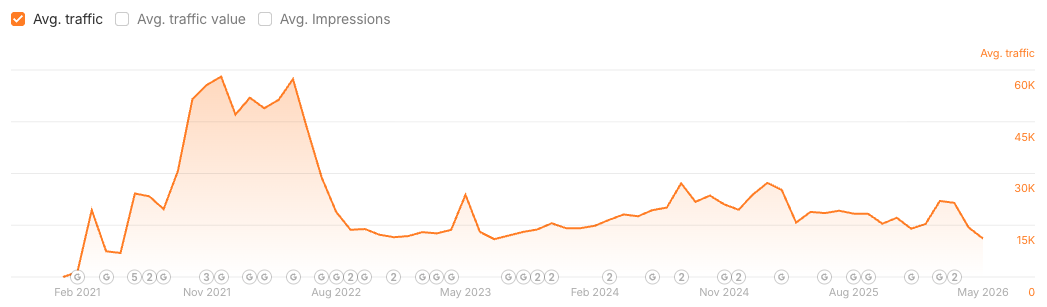

Mióta az AI-n keresztül nagy mennyiségben tudtunk tartalmat előállítani, megjelentek az X-et és a LinkedIn-t hemzsegő grafikonok, általában esettanulmányok vagy értékesítési anyagok részeként.

Egy általam jól ismert keresőoptimalizáló, Martin Sean Fennon megosztott egy példát egy folyamatban lévő márkaesettanulmányról, a tartalom AI-n keresztüli méretezéséről és a tartalom fogadásának módjáról (harmadik féltől származó forgalomméréssel).

A probléma nem mindig az, hogy a tartalmat mesterséges intelligencia készítette; ez mindig is jó megkülönböztető tényező volt a hibáztatásra, mivel sokkal több tényező befolyásolja, hogy a tartalom indexelve van-e vagy sem, nem beszélve a kiszolgálásról.

Az igazi probléma abban rejlik, hogy a tartalomtermelés méretezése, a módszertől függetlenül, gyakran minőség-ellenőrzési problémákat vet fel. Az AI egyszerűen a legújabb és legegyszerűbb bűnbak a tartalomfolyamat alapvető meghibásodásához, amely a kulcsszóstratégiától és a témaválasztástól a szerkesztésig, a belső linkelésig és a terjesztésig mindent magában foglal.

Ez az elosztás azonban nem garantálja a tartós teljesítményt.

A kezdeti hullám gyakran annak az eredménye, hogy a Google rendszerei hatékonyan dolgoznak fel új vagy újszerű tartalmat, ami azt jelenti, hogy „frissebbé” válik. Hasonló frissességnövelést alkalmaz a rendszer, amikor elküld egy URL-t a Google Search Console-on keresztül indexelés céljából.

A küszöb, amellyel jelenleg szembesülünk, a minőség és a relevancia szinten tartása, amint a kezdeti újdonság elmúlik, és a „Mt. AI” hatás alábbhagy, hátrahagyva a mögöttes tartalomminőségi kihívásokat.

Amikor sok új URL-t vezet be webhelyére, arra kéri a Google-t, hogy növelje a webhely erőforrásait, és az, hogy a Google hogyan osztja el ezeket az erőforrásokat, jól dokumentált.

Mivel az észlelt készletük már nem egyezik meg az Ön tényleges készletével, a Google-nak ki kell választania, hogy az új URL-köteg mekkora részét fektesse be, vagy hogy az új URL-ek reprezentatív mintájába fektessen be vagy sem (esetleg URL-minta alapján, pl. egy almappa), majd meg kell néznie, hogy a felhasználók hogyan reagálnak a tartalomra, és hogyan lépnek kapcsolatba vele.

Ez a folyamat meghatározza, hogy a kezdeti frissességnövelés levonása után az URL (és a tartalom) indokolt-e az indexben maradás és a megjelenítés.

Ez a koncepció közvetlenül kapcsolódik a feltérképezési költségkerethez és a Google minőségi küszöbéhez. Ha a minta URL-ek gyengén teljesítenek, vagy nem felelnek meg egy bizonyos minőségi sávnak, miután a kezdeti újdonság elmúlik, a skálázott tartalom fennmaradó része gyakran nehézségekbe ütközik.

Azt is érdemes megjegyezni, hogy a küszöb nem statikus, és idővel változik, ahogy jobb minőségű tartalmat tesznek közzé, amint azt Adam Gent is megjegyezte, és témánként változni fog, mivel nem minden lekérdezés érdemli meg a frissességet.

A mesterséges intelligencia által generált tartalmak, amelyek kezdeti forgalomnövekedéshez vezetnek, amelyet gyorsan egy fennsík vagy hanyatlás követ, jó közösségi posztot eredményez, ugyanakkor rávilágít arra a kulcsra, hogy a probléma nem maga a mesterséges intelligencia, hanem a tartalomstratégia és a minőségellenőrzés alapvető kudarca.

Az AI egyszerűen csak felerősíti a meglévő gyengeségeket. Az új URL-ek „frissebbé tétele” elfedi ezeket a mögöttes problémákat, és a siker átmeneti illúzióját keltve.

Az igazi akadályt a Google minőségi küszöbe jelenti, mivel a Google-nak kezelnie kell az erőforrásokat, és szigorúbbá kell tennie, hogy mit térképezzen fel (és milyen gyakran), és mi maradjon meg az indexben, amely készen áll a megjelenítésre.

Az új URL-ek mintájának felmérésével, hogy kiderüljön, valóban lekötik-e a felhasználókat, és megőrizték-e relevanciáját, elkerülhető az erőforrások pazarlása. Ha ez a minta, vagy a szélesebb skálájú tartalom nem éri el a jelenlegi minőségi küszöböt, akkor az erőforrásokat visszavonjuk, és több „Mt. AI” forgatókönyvnek leszünk tanúi.

Váltás a termelési méretekről a minőségi karbantartásra

Ez azért fontos, mert a mennyiségben kizárólag a mesterséges intelligencia támaszkodása egy hiábavaló mérőszám, amely garantálja a hosszú távú erőforrás-pazarlást.

A hangsúlyt a termelési méretekről a minőségi karbantartásra kell helyezni.

A márkáknak robusztus szerkesztési folyamatokba, embervezérelt stratégiába és aprólékos minőségbiztosításba (beleértve a belső linkeket és terjesztést) kell befektetniük annak érdekében, hogy minden tartalom – akár mesterséges intelligencia által támogatott, akár nem – következetesen túllépje a Google fejlődési küszöbét. Ezt legutóbb Torontóban a Google nem árucikknek szánt tartalomnak minősítette.

Ennek elmulasztása azt jelenti, hogy a tartós, mérvadó organikus teljesítmény kialakítása helyett állandóan a röpke forgalomnövekedést kell követni.