Ezt a bejegyzést a JetOctopus szponzorálta. A cikkben kifejtett vélemények a szponzor sajátjai.

Hogyan optimalizálhatom webhelyemet a ChatGPT és a Perplexity számára, nem csak a Google számára?

Honnan tudhatom, hogy az AI-botok valóban feltérképezik-e a webhelyemet?

Hogyan változzon meg a technikai SEO stratégiám az AI-kereséshez?

2026-ban webhelye keresési megjelenítéseinek jelentős részét az emberek nevében kutató gépek generálják.

Ezeket a gépeket nem érdeklik a kulcsszavak rangsorolása. Érdekli őket, hogy:

- A HTML tisztán betöltődik 200 ezredmásodperc alatt

- A termék részletes oldala kevesebb mint négy kattintással elérhető

- A tartalom egy konkrét, kilencszavas kérdésre ad választ, amely karrierje során soha nem jelent meg egyetlen kulcsszókutató eszközben sem.

Ez nem spekuláció. Ezt mutatják nekünk 2025 közepe óta folyamatosan, több száz vállalati webhelyen tárolt szervernaplóink.

Mi történik valójában az Ön webhelyén

Kollégám, Stan, megjelölt egy mintát egy Slack-üzenetben: a lekérdezések hossza olyan ütemben nőtt, amely nem állt összefüggésben az emberi viselkedéssel.

A 10 szavas lekérdezések éves 161%-os növekedését nem azok a felhasználók okozzák, akik hirtelen bőbeszédűbbé váltak. Ezt az AI-ügynökök hajtják, amelyek egyetlen felhasználói promptot több tucat párhuzamos allekérdezésre bontanak, ezt a folyamatot a kutatók ma „fan-out”-nak nevezik.

Lekérdezés hosszának növekedése 2025-ben

A színátmenet a mondanivaló. Az emberi keresési viselkedés nem skálázza ezt tisztán szószám alapján. A gépek igen. 2025 októberére a több mint 7 szóból álló lekérdezések a teljes lekérdezések mennyiségének közel 1%-át érték el, ami nagyjából háromszorosa a korábbi részesedésüknek.

A mennyiségnél árulkodóbb a CTR. Míg a 10 szavas lekérdezések megjelenítési száma 161%-kal nőtt, az átkattintási arány 2,26%-ra esett vissza, a 2023-as 8–11%-ról.

Az AI beolvassa az oldalt, kivonja a választ, és szintetizálja a felhasználó számára. Webhelye soha nem látogat el.

Ezeket „fantombenyomásoknak” hívjuk. Valós jelzések arról, hogy a tartalmat az AI érvelési láncain belül értékelik. Ha kiszűri őket a jelentésekből, mert nem vezetnek forgalmat, akkor vakon repül.

Az Ön webhelyét meglátogató három bot és hatásuk a SERP láthatóságára

Nem minden mesterséges intelligencia-robot egyenlő, és a legtöbb műszaki keresőoptimalizáló első hibája, ha egyetlen kategóriaként kezelik őket.

Az oktatóbotok másznak nagy vonalakban, és figyelmen kívül hagyja a kattintási mélységet. A képzési látogatás azt jelenti, hogy a mesterséges intelligencia tudja, hogy a tartalom létezik, nem pedig azt, hogy a felhasználók valaha is látják.

AI keresőrobotok két-három kattintás után gyorsan leesik a kezdőlapról, és általában havonta csak egyszer látogat meg minden oldalt.

AI felhasználói botok akkor indulnak el, amikor egy valós személy kérdést tesz fel a ChatGPT-ben, a Perplexityben vagy a Claude-ban, és az AI megkeresi a választ a nevében. Ezek az egyetlen látogatások, amelyek tényleges AI láthatóságot eredményeznek.

| Bot típus | Mi váltja ki | Feltérképezési mélység | Hatás az AI láthatóságára |

| Oktató botok | Oktatási ciklusok modellje | Mély – figyelmen kívül hagyja a kattintási távolságot | Közvetlenül egyik sem. Csak a tudatosság. |

| AI keresőrobotok | Új URL felfedezés és friss tartalom | Sekély – ~1 látogatás/hó 2-3 kattintáson túl | Kritikus kapuőr. Ha kihagy egy oldalt, a felhasználói robotok sem találják meg. |

| AI felhasználói botok | Valódi felhasználói lekérdezés a ChatGPT / Claude / Perplexity szolgáltatásban | Szelektív – a sebesség és a szerkezet vezérli | Magas. Az AI-megjelenítéshez legközelebbi proxy. |

Webhelye erős feltérképezést kaphat a képzési és keresőrobotok miatt, és továbbra is teljesen hiányzik az AI által generált válaszokból. Ha a naplóelemzésben nem típus szerint szegmentálja az AI-bot forgalmat, akkor fogalma sincs, hogy a jéghegy melyik harmadát méri.

Milyen SEO-jeleket tisztelnek az LLM-ek?

A Robots.txt az elsődleges kar.

A legtöbb fő mesterséges intelligencia platform (ChatGPT, Claude, Gemini) követi a robots.txt direktívákat. A Perplexity részleges kivétel: a PerplexityBot tiszteletben tartja a robots.txt fájlt, de a Perplexity-User, a felhasználó által kiváltott bot nem. A Cloudflare ezt egy vizsgálat során megerősítette. A legtöbb webhely nem auditálta a robots.txt fájlját, szem előtt tartva az AI-hozzáférést. Tedd meg.

A webhelytérképek széles körben támogatottak.

A ChatGPT, a Claude és a PerplexityBot XML-webhelytérképeket használ az URL-felderítéshez. Legyen pontos.

A legjobban mentett jelek a keresőoptimalizáláshoz és a rangsoroláshoz

Úgy tűnik, hogy az alábbi jelek nem befolyásolják a mesterséges intelligencia láthatóságát, de továbbra is kulcsfontosságúak a hagyományos SERP-ket kiváltó lekérdezések rangsorolásában.

A kanonikus címkék és a noindex direktívák semmit sem tesznek az AI-botoknál.

Az AI-robotok nem építenek keresési indexet, így nincs hasznuk ezeknek a meta-jeleknek. A Google elől a noindex használatával elrejtett tartalom teljes mértékben látható a ChatGPT feltérképező robotja számára.

Az LLM.txt nem csinál semmit.

Naplóadataink azt mutatják, hogy a fő AI-botok nem olvassák ezt a fájlt. Ne fektessen ide időt.

A JavaScript megjelenítés kritikus vakfolt.

A legtöbb mesterséges intelligencia bejáró (ChatGPT, Claude, Perplexity) nem jeleníti meg a JavaScriptet. Ha a termékoldalak kulcstartalmat töltenek be az ügyféloldalon, akkor ezek az ügynökök egy üres héjat olvasnak. A szerveroldali renderelés az egyetlen univerzálisan működő architektúra. A kivétel a Google Gemini, amely ugyanazt a webes megjelenítési szolgáltatást használja, mint a Googlebot.

Hogyan biztosíthatja, hogy a ChatGPT, a Perplexity és az LLM-ek elérjék a tartalmat

A mesterséges intelligencia keresőrobotjai nagyjából havonta egyszer meglátogatják a mély oldalakat, és a kezdőlapról három kattintás után jelentősen leesnek. A legspecifikusabb, legmegfelelőbb információkat tartalmazó oldalakat gyakran a legnehezebb elérni az ügynökök számára.

A javítás: Emelje fel legértékesebb mélyoldalait belső linkekkel, biztosítva, hogy négy kattintáson belül elérhetők legyenek.

Az oktatóbotok által feltérképezett, de a felhasználói robotok által soha nem elért oldalak a legfontosabb célpontok. Az AI-felhasználó botok által gyakran felkeresett oldalak megmondják, hogy mit kell méretezned: több tartalom, amely ugyanazt a témakört és mélységet fedi le.

Optimalizálja a tartalmat a hosszabb, kimerítő lekérdezésekhez

A mesterséges intelligencia idézeteit eredményező lekérdezések 95%-a nulla havi keresési mennyiséget eredményez. Ezek az AI modellek által generált szintetikus allekérdezések. De megjelennek a GSC-ben: megjelenítések, kattintások nélkül, olyan lekérdezések hossza, amelyeket soha nem célozna meg önként.

Rajongói lekérdezési lehetőségek keresése

Az érdemes lekérdezések megjelenítéséhez csatlakoztassa GSC API-ját a JetOctopushoz (az 1000 soros felhasználói felület korlátjának megkerüléséhez), és szűrje le a következőket: 7 szónál hosszabb lekérdezés, 50 alatti megjelenítések, 0 kattintások az elmúlt 3 hónapban. Ez az Ön Fan-Out Opportunity Matrix, pontosan azok a kérdések, amelyeket az AI-ügynökök tesznek fel a tartalmaival kapcsolatban.

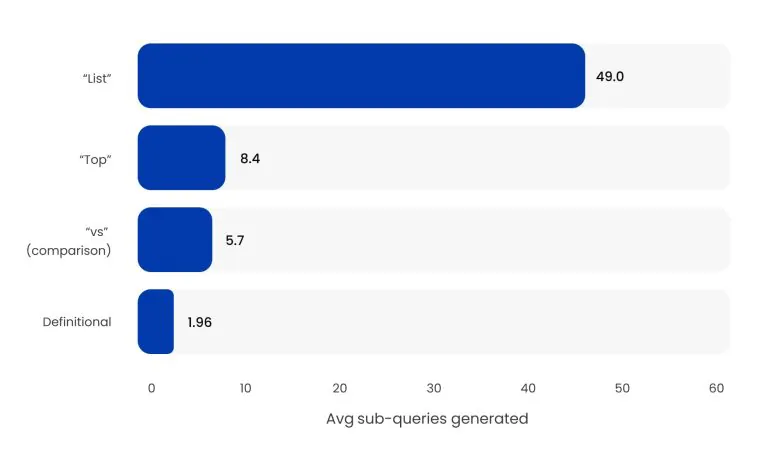

A legtöbbet kedvelő felszólító típusok

Ha a tartalom nem úgy van felépítve, hogy válaszoljon a listás és összehasonlító lekérdezésekre, egyértelmű rangsorolásokkal, előnyeivel/hátrányaival és egymás melletti specifikációival, akkor a legnagyobb kihajtható felület optimalizálatlan marad.

A „Termékfelülvizsgálati” szándékkal kapcsolatos lekérdezések száma a 2025 júniusi 239-ről 2025 szeptemberére több mint 40 000-re emelkedett. Ez a 16 000%-os növekedés annak köszönhető, hogy az AI-ügynökök szisztematikusan gyűjtötték be a strukturált véleményadatokat. Ha a termékoldalakon hiányzik ez a mélység, akkor láthatatlan vagy a betakarítás előtt.

A műszaki audit: hová Indul

1. lépés: Az AI felhasználói robotok forgalmi naplóinak azonosítása

Húzza le a nyers szervernaplókat (Apache/Nginx), és exportálja az ezeket a felhasználói ügynököket tartalmazó összes sort: OAI-SearchBot és ChatGPT-User, PerplexityBot és Perplexity-User, Claude-SearchBot és Claude-User. Ezután manuálisan csoportosítsa a találatokat felhasználói ügynök minták és végpontok szerint egy táblázatban. Az oktatóbotok és a felhasználói robotok megkülönböztetéséhez saját besorolási listát kell vezetnie – amely gyakran változik, és nincs szabványosítva.

A JetOctopus Log Analyzerben ez a szegmentálás be van építve: néhány kattintással szűrhet bot típusa szerint (képzés, keresés és felhasználó), és azonnal láthatja, hogy az AI-felhasználó robotok mely oldalakat keresik fel (az Ön mesterséges intelligencia által látható tartalom, méretezésre kész), illetve azokkal az oldalakkal, amelyeket a oktatóbotok elértek, de a felhasználói robotok soha nem érik el (a legmagasabb prioritású javítási célok).

2. lépés: A mélyoldalak műszaki hozzáférhetőségének ellenőrzése

Válasszon egy mintát a mély URL-ekből, és ellenőrizze a HTML hasznos terhelés méretét, nyers HTML megtekintésével győződjön meg arról, hogy a kulcstartalom nem JavaScript-en keresztül került beadásra, szimulálja a feltérképezés mélységét a kezdőlapról érkező kattintások számlálásával, és tesztelje a betöltési időt a Chrome DevTools vagy Lighthouse alkalmazásban. Azt is ellenőrizze, hogy a fontos tartalom harmonika vagy „További megtekintése” elemek mögött található-e – ezek JavaScript-végrehajtást igényelnek, amelyet az AI-botok teljesen kihagynak. A több ezer mély oldalt tartalmazó nagy webhelyek esetében ez a mintavételi megközelítés sok mindent kihagy. Az AI ügynökök nem kattintanak. Ha az információ csak a felhasználói interakció után jelenik meg, akkor ezeknél a robotoknál nem létezik.

3. lépés: Tisztítsa meg a Robots.txt fájlt

Nyissa meg a robots.txt fájlt, és soronként tekintse át az összes Disallow és Allow utasítást minden user-agent esetében. Az AI-botok a Disallow szabályait követik, ezért ügyeljen arra, hogy véletlenül se blokkolja a fontos URL-eket. Manuálisan tesztelje a kulcs URL-eket, hogy megbizonyosodjon arról, hogy nincsenek letiltva. Itt egy 30 perces ellenőrzés megakadályozhatja, hogy blokkolja a kívánt feltérképező robotokat, vagy olyan tartalmat tegyen közzé, amelyet szívesebben tartson ki.

4. lépés: Térképezze fel fantombenyomásait

Adatok exportálása a GSC teljesítményjelentéseiből a megjelenítések alapján szűrve nulla kattintással. Az 1000 soros felhasználói felület korlátja miatt a GSC API-t kell használnia, vagy dátum és lekérdezés alapján darabokban kell exportálnia, majd egyesítenie kell az adatkészleteket táblázatokban vagy a BigQuery-ben. A lekérdezések gyakoriságát is figyelembe kell venni: a naponta megjelenő hosszú lekérdezések valószínűleg nem fan-outok.

Csatlakoztassa GSC API-ját a JetOctopushoz, hogy megkerülje a sorkorlátot, és automatikusan felépítse a Fan-Out Opportunity Matrixot – pontosan azokat a kérdéseket, amelyeket az AI-ügynökök tesznek fel a tartalommal kapcsolatban, és készen állnak a cselekvésre.

5. lépés: Figyelje a változásokat

Állítson be egy ismétlődő exportálási folyamatot – havonta kérje le a GSC-adatokat, és hasonlítsa össze a megjelenítéseket az idő múlásával, futtassa újra a naplóelemző szkripteket és a bottevékenységek differenciálását, kövesse nyomon a Core Web Vitals-t külön a PageSpeed Insights vagy a CrUX rendszerben. A végén több adatforrást fog összefűzni egységes figyelmeztetés nélkül, ami megnehezíti a regresszió korai észlelését.

A JetOctopus Alerts pontosan ezt fedi le: egységes értesítéseket kap az AI-botok tevékenységének változásairól, valamint a Googlebot viselkedéséről, a Core Web Vitals-ról, az oldalon belüli SEO-problémákról és a SERP hatékonyságának csökkenéséről, így a regressziókat még azelőtt észlelheti, hogy azok összenövekednének.

Az új KPI: Technikai hozzáférhetőség

A SEO 2026-ban egy korlát körül szerveződik át: képes-e egy AI-ügynök 200 ezredmásodperc alatt feltérképezni, elérni és kinyerni egy tényt az Ön 50 000. termékoldaláról?

Ha a válasz nem, akkor a helyezései, a visszamutató linkjei és a tartalom minősége irrelevánssá válik a keresési interakciók egyre nagyobb hányada szempontjából. A gépek keresik. A kérdés az, hogy milyen gyorsan láthatja, mi történik valójában.

Kezdje a naplóival. Minden más onnan következik.

| Szeretné látni, hogy az AI-botok pontosan hogyan hatnak az Ön webhelyére: mely oldalakat érik el, melyeket hagynak ki, és hol rejtőznek a kibontakozási lehetőségei? Foglaljon egy élő bemutatót a JetOctopus platformról. Lekérjük a tényleges naplóadatokat, és megmutatjuk, mit nem árulnak el a GSC jelentései. |